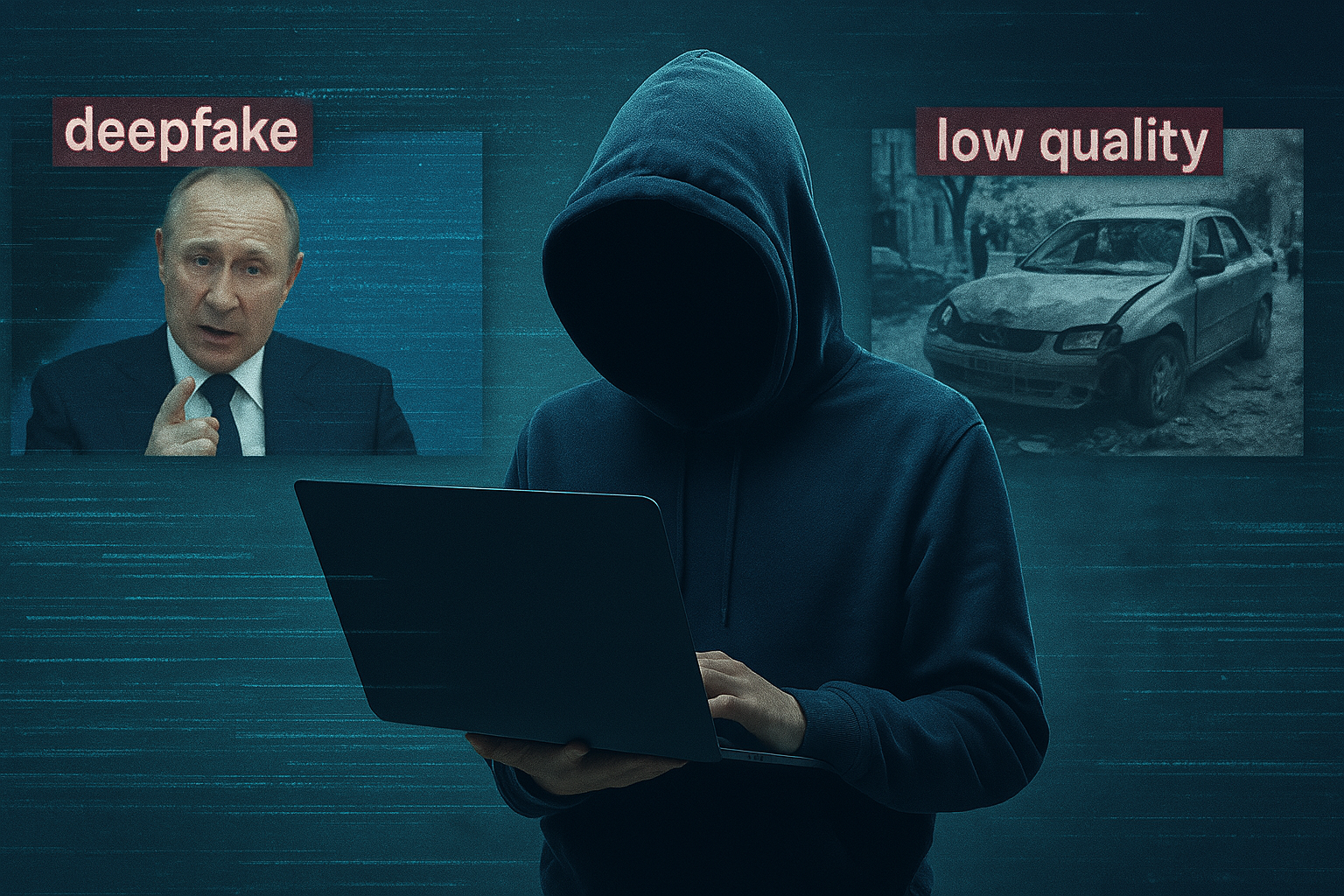

画像生成AI、ディープフェイク、複数モダリティを組み合わせた偽情報が注目を集めるなか、「Visual and Multimodal Disinformation(VMD)」と呼ばれる分野に特化した分析レポートが公開された。欧州の研究機関や政策関係者らによる報告書 “Visual and Multimodal Disinformation” (2025年3月)は、VMDの定義から拡散メカニズム、技術的動向、政策・教育的対応までを包括的にまとめている。本記事では、その構成と主な論点を紹介する。

定義と類型:何が「マルチモーダル」なのか

レポートでは、視覚・マルチモーダル偽情報(VMD)を、以下のような3つの方法で分類している。

- 再文脈化(Recontextualization)

実在の画像・動画・音声を別の文脈に置き換えて誤解を与える手法。例として、過去の戦争や災害の映像を現在の事件に見せかける行為が挙げられる。 - コンテンツ操作(Manipulation)

編集や合成により、実在する情報の一部を加工する。いわゆる「チープフェイク」もこの範疇に含まれる。 - コンテンツ生成(Generation)

AIなどにより新たに作られた画像・音声・動画。いわゆるディープフェイクや画像生成モデルによる創作がこれにあたる。

これらは必ずしも排他的ではなく、複数の手法が組み合わさって使用されることが多い。

技術的特徴と進化

VMDにおける生成技術は、近年GAN(敵対的生成ネットワーク)からディフュージョンモデルへと急速に移行している。Stable Diffusionなどが代表的な例で、検出が困難な高品質生成物の普及が進んでいる。

また、開発元によっては既知の検出器を回避するようなトレーニングが行われている可能性も指摘されている。これにより、生成物の発見自体が難しくなるだけでなく、検出精度を支えるデータベースの無効化も懸念されている。

「truthiness」と拡散の力学

VMDは、「truthiness(それっぽさ)」と呼ばれる心理的効果を利用する。これは、「本当に見える」ことによって内容の信憑性が高まる現象であり、視覚・音声要素が組み合わさることで一層強化されるとされる。

拡散面では、高精度なディープフェイクよりも、簡易なチープフェイクの方が現実的な脅威となるケースも多いとされる。理由としては、制作コストの低さ、拡散速度の速さ、SNSでの感情的反応の喚起力などが挙げられている。

現実の応用例:戦争と災害

ウクライナ戦争では、過去の紛争や災害の映像が「現地の最新映像」として再利用される例が数多く確認された。これにより、VMDが実際の国際政治や世論操作において有効に機能していることが示唆されている。

他にも、地震、火災、暴動などの映像が虚偽の文脈で流用され、誤情報として拡散されるケースが多数報告されている。

対応技術とその限界

VMDへの技術的対抗手段としては、以下のような方法が検討されている:

- 検出AIによる画像・音声の解析

- メタデータの検証と改ざん検知

- コンテンツ認証技術(C2PAなど)の導入

ただし、これらは以下のような限界を持つとされる:

- コンテンツ単体では「意図」までは判別できない

- コンテキストを理解するAI技術は未成熟

- 技術回避型の生成モデルに追いつけない

プラットフォームによるラベリングとその限界

SNSや検索プラットフォームでは、偽情報の拡散抑止策としてラベリング(警告表示)やファクトチェックとの連携が行われている。しかし、レポートでは以下のような課題があるとされている:

- ユーザーが警告を無視する傾向がある

- 「検閲」として反発され、逆効果になる場合がある

- ラベルの信頼性が不透明であると、かえって信頼が損なわれる

政策と多層的対応

レポートでは、EUを中心に複数の政策対応が進められていることが紹介されている。主なものは以下の通り。

- AI Act(人工知能規制法案)

- DSA(デジタルサービス法)

- ELSA、VeraAI、AI4Mediaなどの大型研究プロジェクト

これらは、技術開発、検出精度向上、透明性の確保、リテラシー教育といった複数のレイヤーでVMD対策を行う枠組みとなっている。

一方、米国では州単位の断片的な対応が主であり、連邦レベルの統一的アプローチは取られていないとされている。

「責任の所在」とプラットフォームの役割

VMDが広がる構造においては、誰がどこで責任を負うべきかが不明確になりがちである。生成AIの開発者、画像投稿者、共有者、リポスティング者など、関与主体が多層的であることが問題視されている。

そのため、レポートでは**「トレーサビリティ」や「ガバナンス構造の整備」**が重要な論点として提示されている。

教育・市民社会の取り組み

VMD対策には、技術や規制だけでなく、ユーザー自身のリテラシーが不可欠とされている。市民社会団体、教育機関、研究機関などが協力し、次のような活動が進められている:

- 学校教育におけるメディアリテラシー教材の導入

- デジタル市民教育プログラム

- ファクトチェックの手法解説と拡張

総合的な対策の必要性

レポートは最後に、「検出技術・政策対応・教育の三本柱」を軸とした多層的なアプローチの必要性を強調している。生成物がリアルであるかどうかよりも、「どう使われるか」「何を意図しているか」が問われる時代において、テクノロジーだけで偽情報を防ぐことはできないという前提に立った構成となっている。

コメント

Bei Roulette und Blackjack gibt es Varianten mit Cent-Einsätzen mit Echtgeld, sodass du

nicht viel riskierst und gleichzeitig die Chance hast, einen ordentlichen Gewinn zu holen. Wer vor dem Einsatz von Echtgeld üben möchte, kann dies natürlich mit Spielgeld machen,

doch eignen sich auch Echtgeld Spiele. Den Zugriff alle Casino

Spiele bekommt man grundsätzlich nur mit Einsätzen von Echtgeld.

Besonders beliebt bei Highrollern, die gerne hohe Einsätze

wagen, sind Echtgeld Casino Spiele wie Roulette und Blackjack.

Klarer Testsieger unter den Online Echtgeld Casinos ist Avalon78 mit einer sehr guten Auswahl an Echtgeld Spielautomaten und

einem kompetenten Service.

Im nächsten Abschnitt erwartet euch eine vollständige Tabelle aller getesteten Echtgeld Casinos.

Dazu zählt eine Übersicht der wichtigsten Regulierungsbehörden für

sicheres Glücksspiel und eine schrittweise Anleitung für eure erste Einzahlung im

Online Casino mit Echtgeld. Slots, Tischspiele oder Live Dealer Titel – dazu hohe Auszahlungsraten und faire Gewinnchancen. Meine

Online Casino Liste bietet euch neben dem Testsieger Slotoro nur staatlich lizenzierte, seriöse Anbieter!

Dann seid ihr hier genau richtig, denn hier gibt es alle Echtgeld Casinos auf einer Seite!

Ihr sucht nach den besten Online Casinos mit Echtgeld Spielen und hohen Auszahlungsquoten?

Es gibt zwei Möglichkeiten, Casino Spiele online zu spielen – im Demomodus oder um Echtgeld.

Insgesamt ist die Landschaft der online casino spiele in Deutschland vielfältig und aufregend.

Casino deutschland online bietet Spielern eine sichere

Umgebung, in der sie spielen können, mit der Gewissheit, dass ihre Rechte geschützt sind.

Abschließend ist es wichtig zu betonen, dass

das bestes online casino Deutschland eines ist, das lizenziert und reguliert ist,

um faire Spielbedingungen zu gewährleisten.

References:

https://online-spielhallen.de/iwild-casino-bonus-code-alle-wichtigen-infos-auf-einen-blick/

купить диплом медсестры [url=https://frei-diplom13.ru]купить диплом медсестры[/url] .

To play in demo mode registration is not required, but to play for real

money, you must register and make a deposit on your game

balance. Anyone can play and win big money in this game!

It is easy to start playing Plinko – you just need to go to a reliable casino website, register, make a bet and let

fortune take care of the winnings. This means that any

player can enjoy the game, have fun and make good money.

Casino players and fans of gambling like to play for fun, without big risks and complicated rules, the main thing emotions and excitement.

Although the game has no freespools, bonuses, but the percentage return of

the slot to the player (RTP) reaches 99%.

Study the payout table thoroughly—different Plinko casino variations offer different risk-reward ratios.

Higher risk (fewer landing spots) typically offers bigger rewards.

Start with smaller bets to extend your playing time and increase

gradually only if you’re ahead. Consider the 5% rule—never risk more than 5% of your

total bankroll on a single drop.

On iPhone and iPad, you may find an app in the Apple App Store, or download it directly

from the casino site. Top providers like Spribe and BGaming always offer their Plinko in both demo and real-money formats on official casino platforms.

Before your first bet, review withdrawal rules

and any wagering tied to bonuses. You can usually wager $0.10

to $100 per drop, though limits vary by provider and

casino. You drop a ball at the top of a triangular pegboard.

References:

https://blackcoin.co/aussie-play-casino-complete-guide-for-australian-players/

With views stretching across the Yarra River and downtown Melbourne,

the Crown casino is situated in the perfect location. The

Crown casino is a formidable venue, read our guide for more.

Despite being our largest state by far, the spaced out nature of WA’s population means that there’s only one casino in the

whole territory and that can be found, not surprisingly,

in Perth. Taz also has duel casino status, with the Wrest Point, Australia’s first casino, and the Country Couple competing for best on the island.

Online casino loyalty programs reward regular players with exclusive bonuses, exclusive casino bonus codes, and priority customer support.

We only recommend online casinos that use secure payment

gateways compliant with industry standards and regulatory requirements.

We recommend choosing online casino bonuses with low wagering requirements,

ideally 30x or less.

AU online casinos use bonus rewards to set themselves apart from the rest.

Online casino bonuses are important to the players and the casinos.

The AU online casinos we have recommended have libraries full of

different types of online pokies. However, most phones have web browsers

and nearly all online casinos have mobile sites that you can easily access.

If there is no real money app that is compatible with your phone, you should always be

able to use your mobile based web browser to play on the online casino mobile site.

online casino australia paypal

References:

https://popijob.com/employer/our-favorite-paypal-casinos-2025-ranking-update/

online casino paypal

References:

https://supplychainjobs.in/employer/online-casino-mit-paypal-einzahlung-die-top-casinos-im-vergleich/

paypal casino uk

References:

https://metagap.ro/employer/play-pokies-real-money-with-instant-withdrawal

usa casino online paypal

References:

https://precisionscans.net/employer/best-online-casinos-australia-top-aussie-real-money-sites-2025/

paypal casino android

References:

kairoskonnectinc.com

Small businesses thrive with TeamViewer’s secure remote desktop client that transforms day-to-day operations. “Handling requests remotely reduces time until recovery, since it eliminates staff travel times. At the same time, our customers feel much better served and supported with the fast support. This has convinced our service team just as quickly and sustainably as the users.”

The secure encryption protocols protect sensitive work data across these varied networks, addressing a key concern for remote professionals who handle client information. Alternatively, access and start using TeamViewer on your iPhone, iPad, Android phone, or Android tablet (any manufacturer) by opening the web app in your browser or following the download link for your device from the website. Remotely wake up and restart devices in sleep mode to keep operations running smoothly. TeamViewer Remote offers a simple, efficient way to monitor, maintain, update, and optimize delocalized computers, devices, and applications.

References:

https://blackcoin.co/ufo9-casino-your-place-to-play-your-way/

paypal casinos for usa players

References:

precise.co.za

casino mit paypal

References:

businessxconnect.com

paypal casino usa

References:

https://www.paknaukri.pk/companies/top-online-pokies-for-real-money-in-2025-for-aussie-players

References:

Online blackjack

References:

etuitionking.net

References:

Test prop anavar cycle before and after

References:

socialbookmarknew.win

References:

L’auberge casino baton rouge

References:

https://www.24propertyinspain.com/

foods with natural steroids

References:

–7sbarohhk4a0dxb3c.рф

mental health cases in steroid abuse|acybgntbgv0jfnkoyks0e75iu3dejdmsdw:***

References:

http://hikvisiondb.webcam/index.php?title=polandkevin93

best muscle building drugs

References:

https://moparwiki.win

legit steroids for sale

References:

opensourcebridge.science

weight loss steroids for men

References:

kanban.xsitepool.tu-freiberg.de

References:

Anavar girl before and after

References:

dubizzle.ca

References:

Before and after test cyp 500 week and anavar pics

References:

http://www.udrpsearch.com

References:

Test and anavar before and after pics

References:

https://skitterphoto.com/photographers/2134476/salinas-marks

euro labs steroids

References:

https://bookmarkingworld.review/

References:

Best time to take anavar before or after workout

References:

trade-britanica.trade

References:

Rising sun casino

References:

may22.ru

References:

Excalibur casino

References:

https://doodleordie.com

References:

William hill online casino

References:

http://humanlove.stream

References:

Lucky slots app

References:

https://etuitionking.net/

gnc muscle building

References:

dreevoo.com

can you buy steroids

References:

pattern-wiki.win

anavar illegal

References:

hikvisiondb.webcam

steroids classification

References:

gpsites.win

References:

Aurora casino

References:

clashofcryptos.trade

References:

Roulette odds

References:

https://tran-mackenzie-2.federatedjournals.com/

References:

Roulette soad

References:

zenwriting.net

References:

Casino bet365

References:

pediascape.science

References:

Wolf run slots

References:

https://yogaasanas.science

References:

Legends casino

References:

urlscan.io

References:

Vegas casino

References:

https://swaay.com/u/germieklmik35/about

References:

Best games on mac

References:

dreevoo.com

References:

New york new york casino las vegas

References:

rentry.co

anabolic steriods online

References:

https://rentry.co

supplements vs steroids

References:

https://kanban.xsitepool.tu-freiberg.de/s/SyVMx–vbx

how to get prescribed steroids legally by a doctor

References:

https://cuwip.ucsd.edu/

References:

Eurogrand casino

References:

dranus.ru

professional bodybuilders steroid cycles

References:

yogicentral.science

Thanks for any other informative blog. The place else may just I am getting that kind of info written in such an ideal approach? I’ve a project that I’m simply now operating on, and I have been on the glance out for such info.

winstrol v pills

References:

jobs.emiogp.com

gnc amp ripped

References:

https://cameradb.review/wiki/AnavarWirkung_Auf_Muskel_Und_Fettabbau_7_Wissenschaftlich_Fundierte_Erkenntnisse

best mass building steroids

References:

bbs.pku.edu.cn

can anabolic steroids cause diabetes

References:

https://imoodle.win/wiki/Trenbolone_Uses_Benefits_Side_Effects_Natural_Alternatives

mystic island casino

References:

https://urlscan.io/result/019c845e-5fad-71dc-a45f-376477ee5b6d/

crazy vegas casino

References:

https://www.mixcloud.com/sailorhome25/

creek nation casino

References:

https://dickerson-lunde-3.technetbloggers.de/casinos-mit-schneller-auszahlung-sofort-gewinne-2026

swiss casino online

References:

https://peatix.com/user/28992360

le saint laurent

References:

https://apunto.it/user/profile/672267

gamehouse casino plus

References:

https://invastu.kz/user/foodwomen8/

treasure island jackpots

References:

http://gojourney.xsrv.jp/index.php?drakebox4

ohio casino control commission

References:

https://linkvault.win/story.php?title=fair-go-casino-progressive-jackpot-pokies-guide

kansas casinos

References:

https://bookmarkspot.win/story.php?title=the-brand-mr-bet-canada-casino-withdrawal-time-new-casinos-on-the-internet-in-australia-2025-2026

betvictor slots

References:

https://a-taxi.com.ua/user/asiapin1/

casino club chicago

References:

https://chessdatabase.science/wiki/Galaxy_96_Casino_Review_Australia_Bonuses_Games_Banking

canadian gaming summit

References:

http://volleypedia-org.50and3.com/index.php?qa=user&qa_1=chancecare58

soaring eagle casino coupons

References:

https://yogaasanas.science/wiki/Best_EWallet_Casinos_Australia_2026_Skrill_Neteller_More

osage casino tulsa

References:

https://tarbiyah.alqolam.ac.id/2022/06/21/jadwal-ujian-proposal-dan-sidang-skripsi-fakultas-tarbiyah-bulan-juni-pekan-ke-iv/

seminole hard rock casino

References:

https://watbosa.ac.th/question/csfhhgggg/

geantcasino fr

References:

https://legal-immobilier.fr/optimiser-la-rentabilite-de-son-bien-locatif/

tiger online check in

References:

https://innovativeforge.com/exploring-new-horizons-adventures-await/

genting casino newcastle

References:

https://www.elsieisy.com/snapchat-5366124957696983820/

casino monaco

References:

https://animallovergifts.com/wipes/

casino connecticut

References:

http://yashichi.com/mainimg-1-300×113/

aliante casino las vegas

References:

https://raskrussia.ru/blog/vopros-vozvrashcheniya-rossiyskikh-prygunov-na-lyzhakh-s-tramplina-i-dvoebortsev-na-mezhdunarodnye-starty-ostaetsya-otkrytym/

riverwalk casino vicksburg ms

References:

https://vietlinklogistics.com/gioi-thieu/tam-nhin-su-menh.html

best supplement stack for cutting and muscle gain

References:

https://www.bandsworksconcerts.info:443/index.php?bodycoffee9

how do you make steroids

References:

http://digitaltibetan.win/index.php?title=Post:Viagra_sans_ordonnance_les_meilleures_alternatives_lgales_acheter&action=submit

supplement like steroids

References:

https://classifieds.ocala-news.com/author/rollfear0

anabolic steroid deca

References:

https://yogicentral.science/wiki/Clenbuterol_for_Bodybuilding_Side_Effects_Benefits_Risks

most common steroids

References:

https://gaiaathome.eu/gaiaathome/show_user.php?userid=1866094

health risks of steroids

References:

https://molchanovonews.ru/user/foxonion6/

References:

River spirit casino tulsa ok

References:

https://justicefornorthcaucasus.com/jfnc_message_boards/turkey.php?entry_id=1292630032&title=g%C3%9Cnaydin-rusya%21&comments=comments

Real wonderful info can be found on site. “I don’t know what will be used in the next world war, but the 4th will be fought with stones.” by Albert Einstein.

I very delighted to find this web site on bing, just what I was looking for : D as well saved to fav.

Please let me know if you’re looking for a writer for your blog. You have some really good posts and I feel I would be a good asset. If you ever want to take some of the load off, I’d really like to write some material for your blog in exchange for a link back to mine. Please send me an e-mail if interested. Thanks!